近日,中关村华安关键信息基础设施安全保护联盟(以下简称“关保联盟”)、《中国信息安全》杂志社、中国安全网络创新发展联盟联合主办的“AI+低空经济与数字化生态安全”技术研讨会在京召开。来自国家部委、中央企业、网络安全企业和科研机构的百余位专家学者齐聚一堂,围绕“AI+”时代的安全挑战与技术路径,深入探讨数字化新生态下的安全新范式。

会上,知道创宇联合创始人杨冀龙围绕“大模型安全风险及治理”发表了主旨演讲。

杨冀龙指出,大模型应用在当下的发展中暴露出诸多系统性风险。

一方面,数据泄露与商业机密安全问题突出。大模型的应用使得数据和商业机密面临被泄露的风险,各类AI应用更是导致漏洞安全问题集中爆发。此外,如Ollama等大模型工具,已被发现默认配置存在未授权访问与模型窃取等安全隐患。

另一方面,应高度警惕大模型生成内容合规风险。大模型可能通过“时间绕过”“地点欺骗”“情绪操控”等方式绕过审查,生成涉政、暴力或色情等违规的文本、视频内容,甚至利用越狱字符串突破安全检测。而且,大模型的训练数据来源广泛,若原始语料遭到污染或恶意植入,将直接影响模型的行为与输出,带来极大的内容安全风险。

此外,AI滥用正逐渐演化为一种新型犯罪手段。不法分子利用AI模仿语音和行为实现精准诈骗,伪装度极高,给社会造成了巨大的经济损失。AI勒索、AI诈骗等新型犯罪行为不断涌现,对传统安全体系构成了巨大挑战。

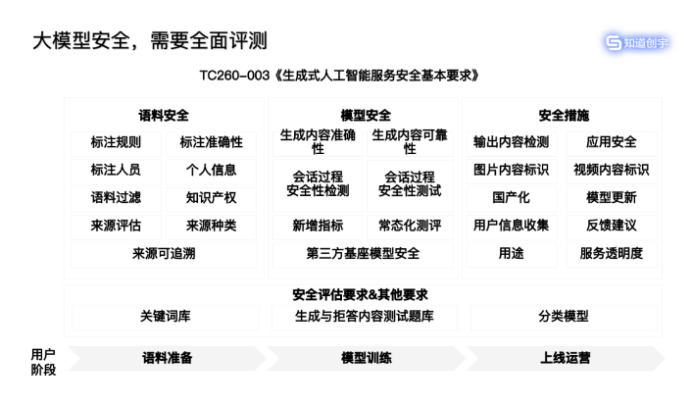

面对上述挑战,杨冀龙提出,构建大模型全生命周期安全防护体系,包括语料安全、算法安全、应用安全、过滤机制等。

他强调,不论是行业级大模型还是面向公众的大模型服务,都应该接受系统性的安全评测,确保符合TC260-003《生成式人工智能服务安全基本要求》。

知道创宇凭借十余年深耕内容审核领域的经验,以及公司长期奋战在对抗“黑灰产”的最前线的深厚技术沉淀,已构建了完备的大模型安全评测服务体系。

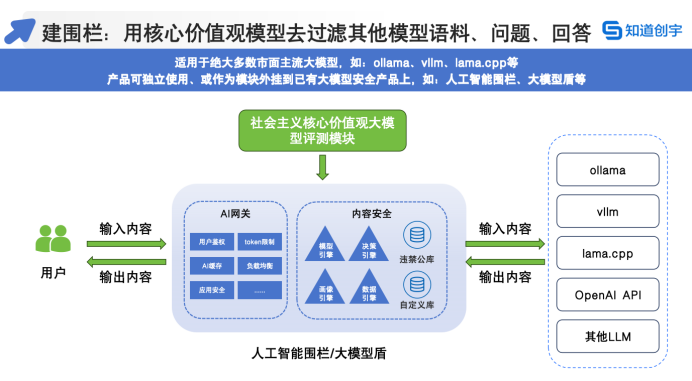

杨冀龙表示,知道创宇核心价值观大模型积累了大量的问题题库,涵盖网络安全、内容安全和数据隐私保护等诸多方面。基于核心价值观模型去对现有大模型进行评测,可以实现2分钟极速配置,实时查看评测结果,生成评测分析报告。

“在海量题库中,在大模型评测过程中会挑选几千个问题,自动进行问答,并对问答结果进行逐一进行校对,以确保无误。”他说。

目前,知道创宇核心价值观大模型可对现有国内外大模型进行合规评测,有效提升大模型的安全性和可靠性,为构建合规、可信的AI应用生态提供有力支撑。核心价值观大模型还可作为外部模型评测与过滤的核心引擎,支持对主流模型进行接入式安全评估与问题过滤。它不仅支持独立部署,也可作为模块外挂至其他安全产品中,如人工智能围栏、大模型盾等,实现对大模型应用的合规把控。

审核:徐倩倩 徐金挺

校对:米果 晓符